AI工具包常见问题解答

模型

我如何找到我的远程型号端点和认证头部?

以下是一些关于如何在常见 OpenAI 服务提供商中找到端点和认证头的示例。对于其他提供商,你可以查看他们关于聊天完成端点和认证头部的文档。

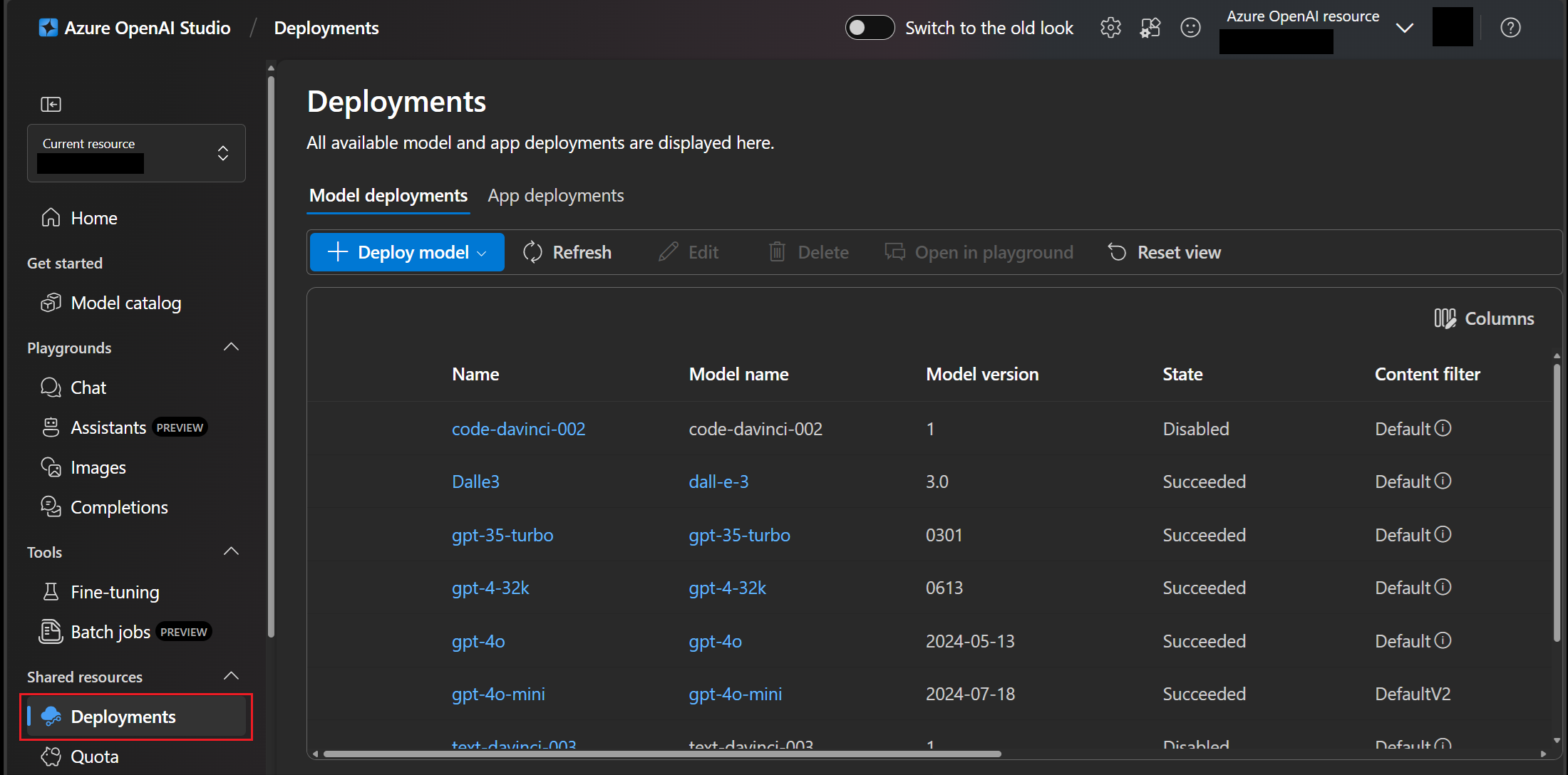

示例1:Azure OpenAI

-

在 Azure OpenAI Studio 中的部署刀片中选择部署,例如,

GPT-4O.如果你还没有部署,可以查看Azure OpenAI文档了解如何创建部署。

-

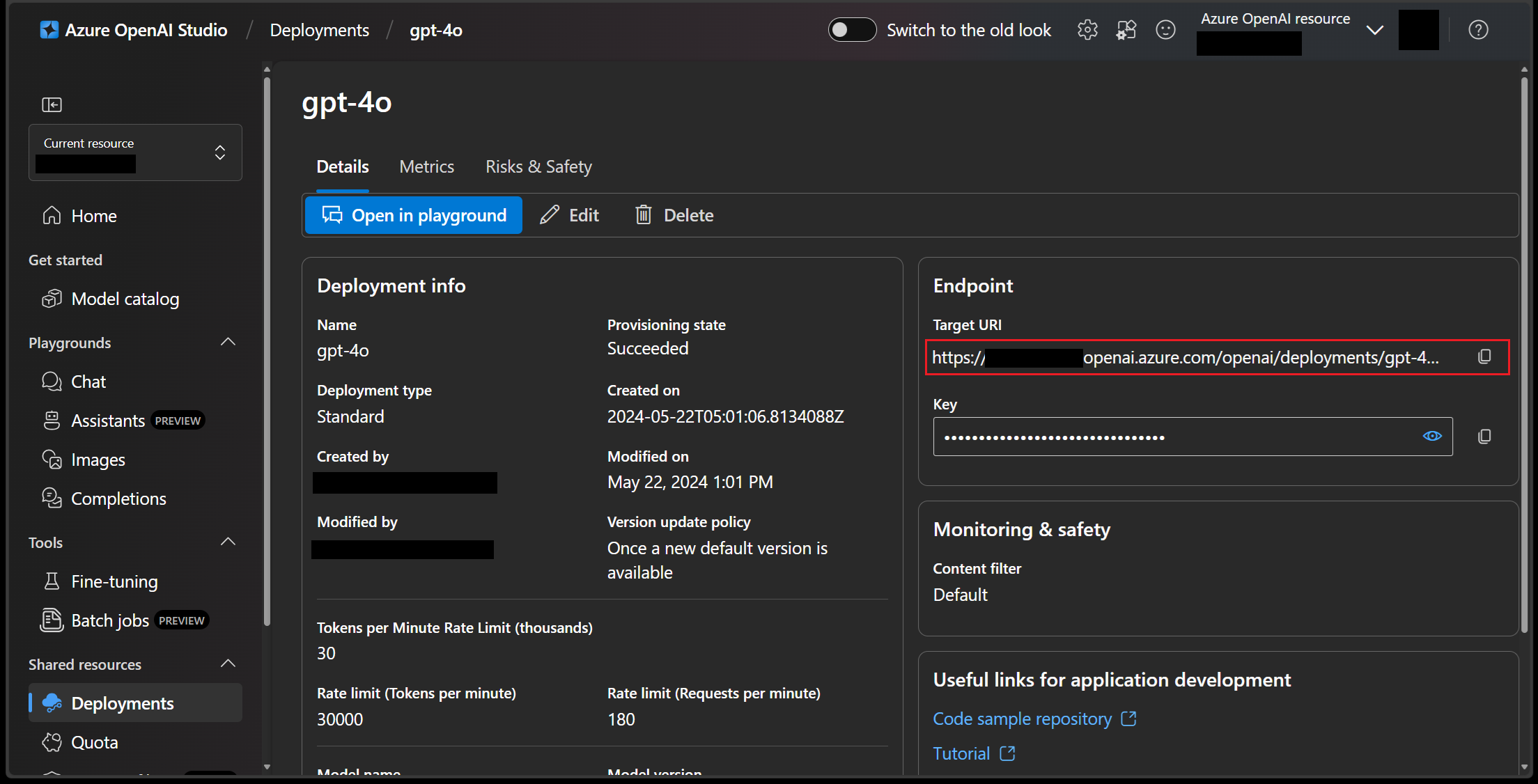

在端点部分的目标 URI 字段中获取你的聊天完成端点

-

从端点部分的密钥属性获取API密钥。

复制API密钥后,将它添加为以下格式

API-key:<YOUR_API_KEY>用于 AI Toolkit 中的认证头。请参阅Azure OpenAI服务文档以了解更多关于认证头的信息。

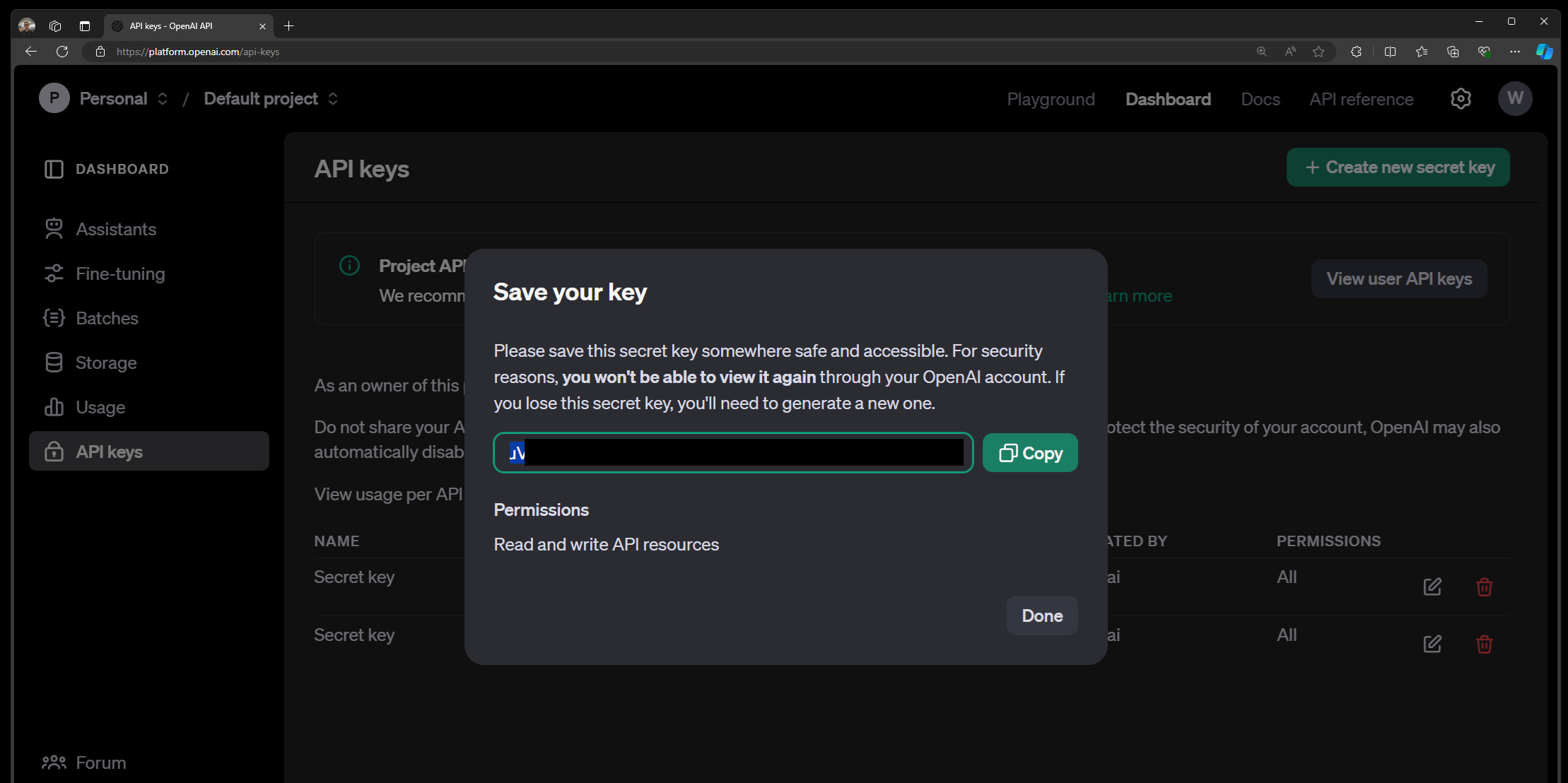

示例2:OpenAI

-

目前,聊天结束端点固定在

https://api.openai.com/v1/chat/completions.想了解更多,请参阅OpenAI文档。 -

进入OpenAI文档并选择

API 密钥或项目API密钥创建或检索您的API密钥。复制API密钥后,请以以下格式填写

授权:承载者<YOUR_API_KEY>用于 AI Toolkit 中的认证头。更多信息请参见OpenAI文档。

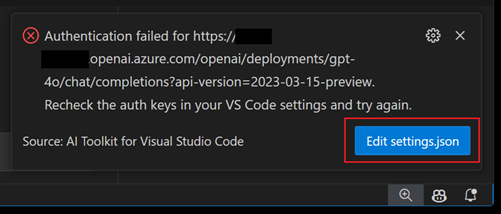

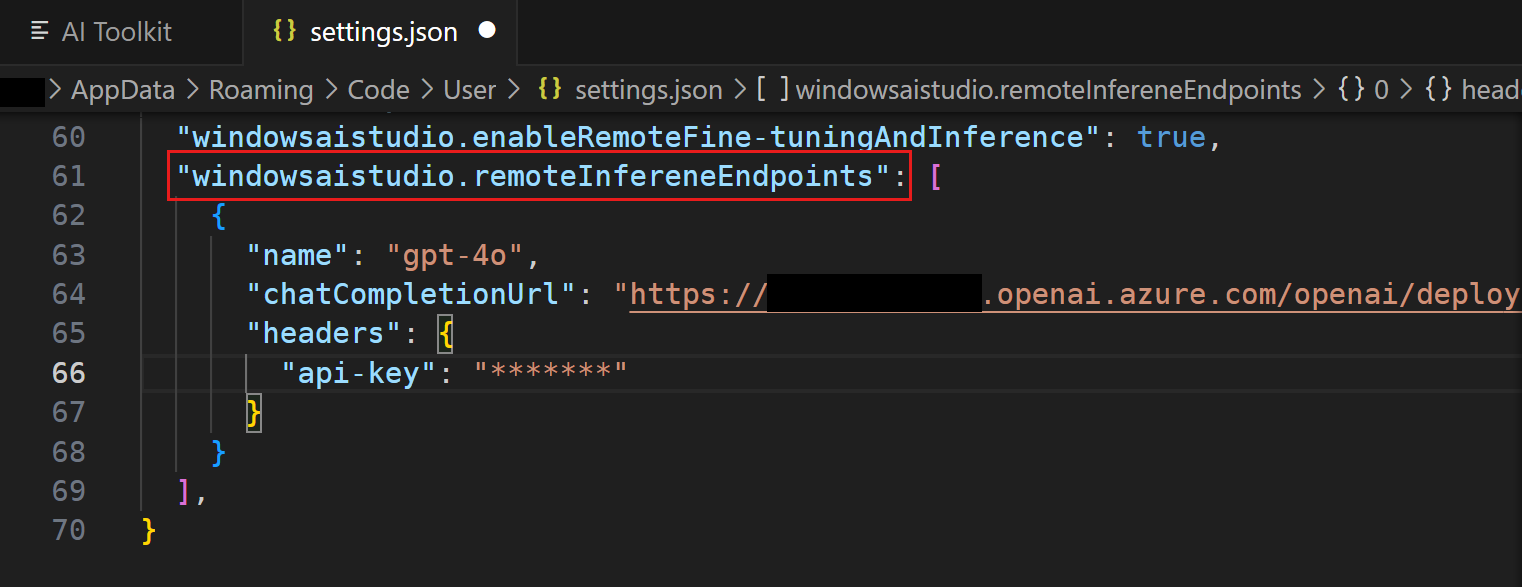

如何编辑端点URL或认证头?

如果你输入错误的端点或认证头,推理时可能会遇到错误。

-

打开VS代码

setting.json文件:-

精选

编辑settings.json在认证失败通知中

-

或者,输入

打开用户设置(JSON)在命令面板中(⇧⌘P(Windows,Linux Ctrl+Shift+P))

-

-

搜索

windowsaistudio.remoteInfereneEndpoints背景设定 -

编辑或删除现有的端点URL或认证头部。

保存设置后,树状视图或游乐场中的模型列表会自动刷新。

我如何加入OpenAI o1-mini或OpenAI o1-preview的候补名单?

OpenAI o1系列模型专门设计用于提升专注力和能力的推理和问题解决任务。这些模型花更多时间处理和理解用户的需求,使其在科学、编程、数学等领域表现异常强大。例如,o1可以被医疗研究人员用于注释细胞测序数据,物理学家用于生成量子光学所需的复杂数学公式,以及各领域开发者用于构建和执行多步工作流程。

o1预览版仅限有限度访问。要在游乐场试用该模型,需要注册,访问权限根据Microsoft的资格标准获得。

请访问GitHub模型市场,查找OpenAI o1-mini或OpenAI o1-preview,加入候补名单。

我可以用我自己的模型或Hugging Face的其他模型吗?

如果你自己的模型支持 OpenAI API 合约,你可以将其托管在云端,并将模型作为自定义模型添加到 AI Toolkit。你需要提供关键信息,比如模型端点的URL、访问键和模型名称。

微调

有许多微调设置。我需要担心所有这些吗?

不,你可以用默认设置和我们的样本数据集进行测试。你也可以自己选择数据集,但需要调整一些设置。更多信息请参见微调教程。

AI 工具包不为微调项目提供支架

安装扩展前一定要确认扩展的前提条件。

我有NVIDIA GPU设备,但前置条件检查失败了

如果你有 NVIDIA GPU 设备,但前置条件检查失败,显示“未检测到 GPU”,请确保安装了最新的驱动。你可以在NVIDIA官网查看并下载驱动。

另外,确保它安装在路径上。要验证,请运行英伟达-SMI从命令行。

我生成了项目,但Conda激活时找不到环境

可能是环境设置出了问题。你可以手动初始化环境,方法是用bash /mnt/[PROJECT_PATH]/setup/first_time_setup.sh从工作区内部。

使用Hugging Face数据集时,我该如何获得它?

在你开始之前Python 微调/invoke_olive.py指挥部,确保你跑Huggingface-CLI 登录指挥部。这确保了数据集可以代表你下载。

环境

这个扩展在Linux或其他系统上能用吗?

是的,AI Toolkit 支持 Windows、Mac 和 Linux。

我怎样才能禁用我的WSL中的Conda自动激活功能

要在WSL中禁用Conda安装,请执行Conda config --Set auto_activate_base false.这会禁用基础环境。

你们现在支持集装箱吗?

我们目前正在开发容器支持,未来版本会启用。

你为什么需要GitHub和Hugging Face的凭证?

我们把所有项目模板托管在 GitHub,基础模型托管在 Azure 或 Hugging Face 上。这些环境需要账户才能通过API访问。

我在下载Llama2时出现错误

请确保你通过Llama 2注册页面申请访问Llama。这是符合Meta贸易合规的要求。

我无法在WSL实例中保存项目

由于目前运行 AI Toolkit 动作时不支持远程会话,连接 WSL 时无法保存项目。要关闭远程连接,请在屏幕左下角选择“WSL”,然后选择“关闭远程连接”。

错误:GitHub API 被禁止

我们将项目模板托管在微软/Windows-AI-Studio-模板GitHub仓库,扩展使用GitHub API加载仓库内容。如果你在Microsoft,可能需要授权Microsoft组织以避免这种禁止的问题。

请参见本问题作为解决方法。具体步骤如下:

-

从 VS Code 登出 GitHub 账户

-

重新加载 VS Code 和 AI 工具包,你将被要求再次登录 GitHub

-

重要提示:在浏览器的授权页面,确保授权应用访问Microsoft组织

无法列出、加载或下载ONNX型号

查看 VS Code 输出面板中的 AI 工具包日志。如果看到Agent错误或无法下载模型,就关闭所有 VS Code 实例并重新打开 VS Code。

(这个问题是由于底层的ONNX代理意外关闭引起的,上述步骤是重启代理。)