在AI工具包中探索模型

AI 工具包为各种生成式 AI 模型提供全面支持,包括小型语言模型 (SLM) 和大型语言模型 (LLM)。

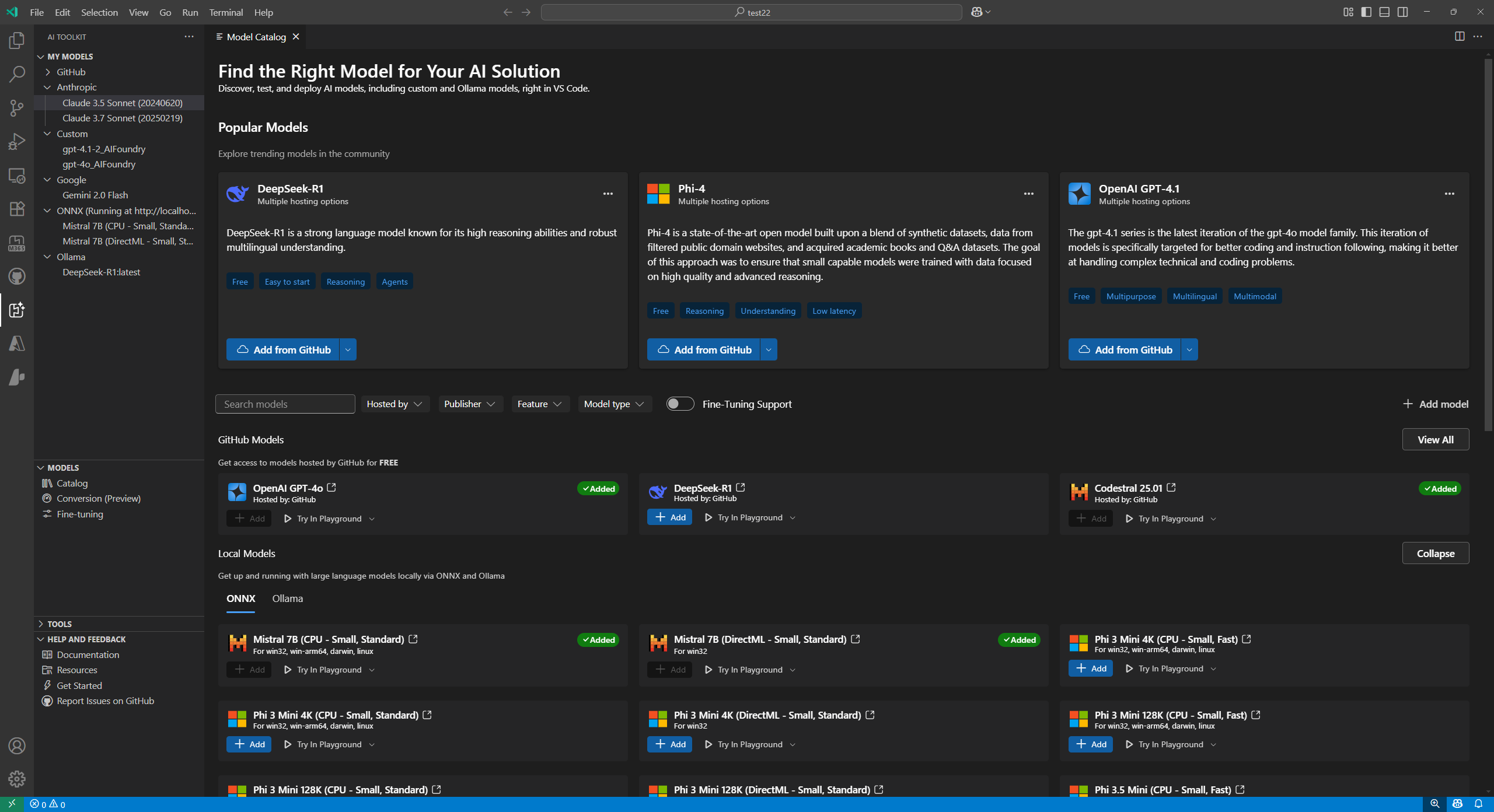

在模型目录中,您可以探索和利用来自多个托管源的模型:

- 托管在GitHub上的模型,如Llama3、Phi-3和Mistral,包括按使用付费选项。

- 由出版商直接提供的模型,包括 OpenAI 的 ChatGPT、Anthropic 的 Claude 和 Google 的 Gemini。

- 托管在微软Foundry的模型。

- 从Ollama和ONNX等仓库本地下载的模型。

- 通过自定义自托管或外部部署模型,通过自定义模型(BYOM)集成进行访问。

直接从模型目录中将模型部署到Foundry,简化您的工作流程。

使用 Microsoft Foundry、Foundry Local 和 GitHub 模型,这些模型已添加到 AI 工具包中,并与 GitHub Copilot 集成。有关更多信息,请查看 更改聊天对话的模型。

找到一个模型

要查找模型目录中的模型:

-

在活动栏中选择AI工具包视图

-

选择型号 > 目录 打开型号目录

-

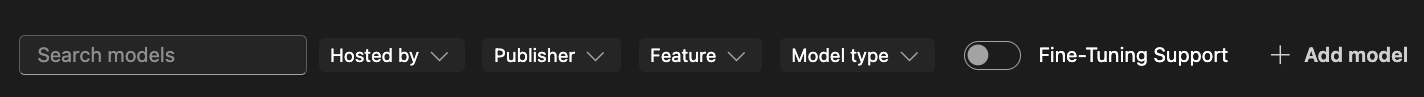

使用筛选器来减少可用型号的列表

- 托管方:AI 工具包支持 GitHub、ONNX、OpenAI、Anthropic、Google 作为模型托管来源。

- 发布者:AI 模型的发布者,例如微软、Meta、谷歌、OpenAI、Anthropic、Mistral AI 等。

- 功能:模型支持的功能,例如

文本附件,图片附件,网页搜索,结构化输出,以及更多。 - 模型类型:筛选可以在 CPU、GPU 或 NPU 上远程或本地运行的模型。此筛选取决于本地可用性。

- 微调支持:显示可用于运行微调的模型。

-

浏览不同类别的模型,例如:

- 热门模型 是一个精心挑选的列表,包含在各种任务和领域中广泛使用的模型。

- GitHub 模型 提供了对托管在 GitHub 上的流行模型的便捷访问。它最适合快速原型设计和实验。

- ONNX 模型 优化用于本地执行,并且可以在 CPU、GPU 或 NPU 上运行。

- Ollama 模型 是受欢迎的模型,可以使用 Ollama 在本地运行,并通过 GGUF 量化支持 CPU。

-

或者,使用搜索框通过名称或描述查找特定型号

从目录中添加一个模型

要添加模型目录中的模型:

-

在模型目录中找到您要添加的模型。

-

选择 添加 在模型卡上

-

根据提供商不同,添加模型的流程会略有不同:

-

GitHub:AI 工具包需要您的 GitHub 凭据来访问模型库。一旦验证通过,模型将直接添加到 AI 工具包中。

注意AI 工具包现在 支持 GitHub 按使用量付费模式,因此您在免费层级限制之后仍可以继续工作。

-

ONNX:该模型从ONNX下载并添加到AI工具包。

-

Ollama:该模型从Ollama下载并添加到AI Toolkit。

小贴士您可以在稍后通过右键单击模型并选择编辑来编辑API密钥,并在查看加密值

${HOME}/.aikt/models/my-models/yml文件。

-

OpenAI、Anthropic和Google:AI 工具包需要您输入 API 密钥。

-

自定义模型:参考自定义模型部分的详细说明。

-

一旦添加,该模型会出现在我的模型下树视图中,并且您可以在游乐场或智能体构建器中使用它。

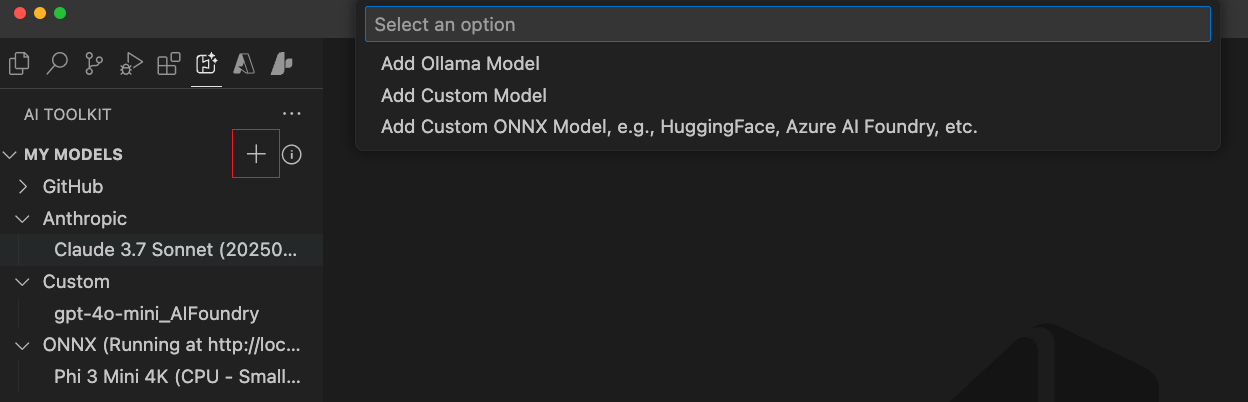

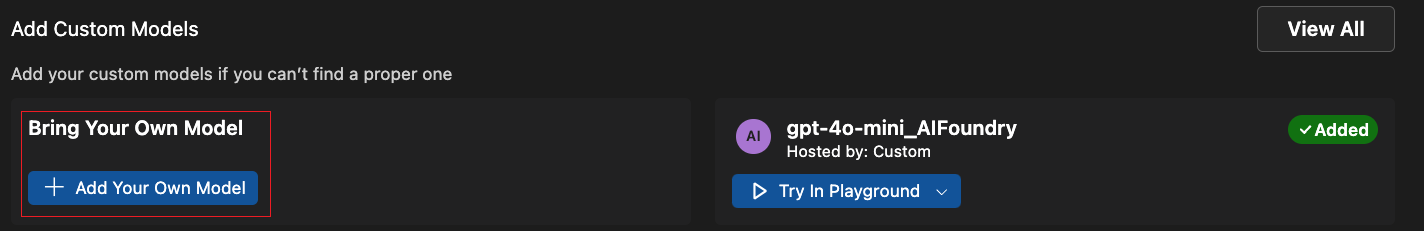

添加自定义模型

您还可以添加外部托管或本地运行的自己的模型。有几种选择:

- 添加来自Ollama库的Ollama模型或自定义的Ollama端点。

- 添加具有 OpenAI 兼容端点的自定义模型,例如自托管模型或在云服务上运行的模型。

- 使用AI Toolkit的模型转换工具添加自定义ONNX模型,例如来自Hugging Face的模型。

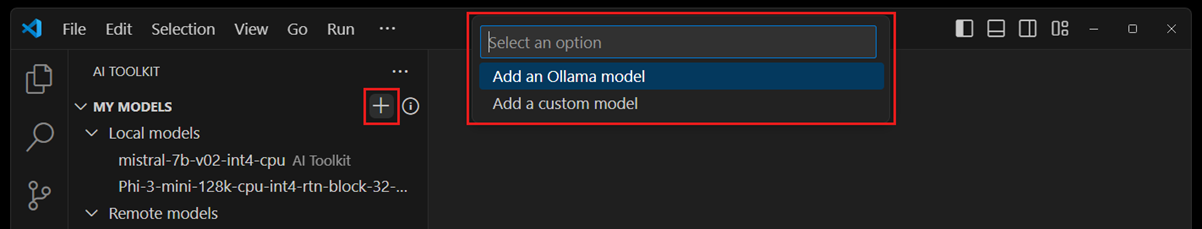

有几种方法可以将模型添加到AI工具包中:

-

从 我的模型 在树视图中,悬停并选择

输入:+图标。

-

从 模型目录中,选择工具栏上的 + 添加模型 按钮。

-

从模型目录中的自定义模型部分,选择+ 添加您自己的模型。

添加Ollama模型

Ollama 通过 GGUF 量化使许多流行的生成式 AI 模型能够本地运行 CPU。如果你在本地机器上安装了 Ollama 并下载了 Ollama 模型,你可以将它们添加到 AI 工具包中,以便在模型游乐场中使用。

在 AI 工具包中使用 Ollama 模型的先决条件:

- AI 工具包 v0.6.2 或更新版本。

- Ollama (测试于 Ollama v0.4.1)

将本地Ollama添加到AI工具包

-

从上面提到的入口之一中,选择添加Ollama模型。

-

接下来,选择 从Ollama库中选择模型

如果你在不同的端点启动Ollama运行时,选择提供自定义Ollama端点来指定一个Ollama端点。

-

选择您想要添加到AI工具包的模型,然后选择确定

-

您现在应该在树视图的模型列表中看到所选择的Ollama模型。

注意目前Ollama模型不支持附件。因为我们通过其兼容OpenAI的端点连接到Ollama,而它目前不支持附件。

添加一个与 OpenAI 兼容的自定义模型端点

如果你有一个可以透过互联网访问的、与 OpenAI 兼容的自托管或部署模型的端点,你可以将其添加到 AI 工具包中并在游乐场中使用它。

- 从上面的入口点之一,选择添加自定义模型。

- 输入OpenAI兼容的端点URL和所需信息。

要添加一个自托管或本地运行的Ollama模型:

- 选择 + 添加模型 在模型目录中。

- 在快速选择模型中,选择 Ollama 或 自定义模型。

- 输入所需的详细信息以添加模型。

添加自定义 ONNX 模型

要添加自定义 ONNX 模型,请首先使用模型转换工具将其转换为 AI 工具包模型格式。转换后,将模型添加到 AI 工具包。

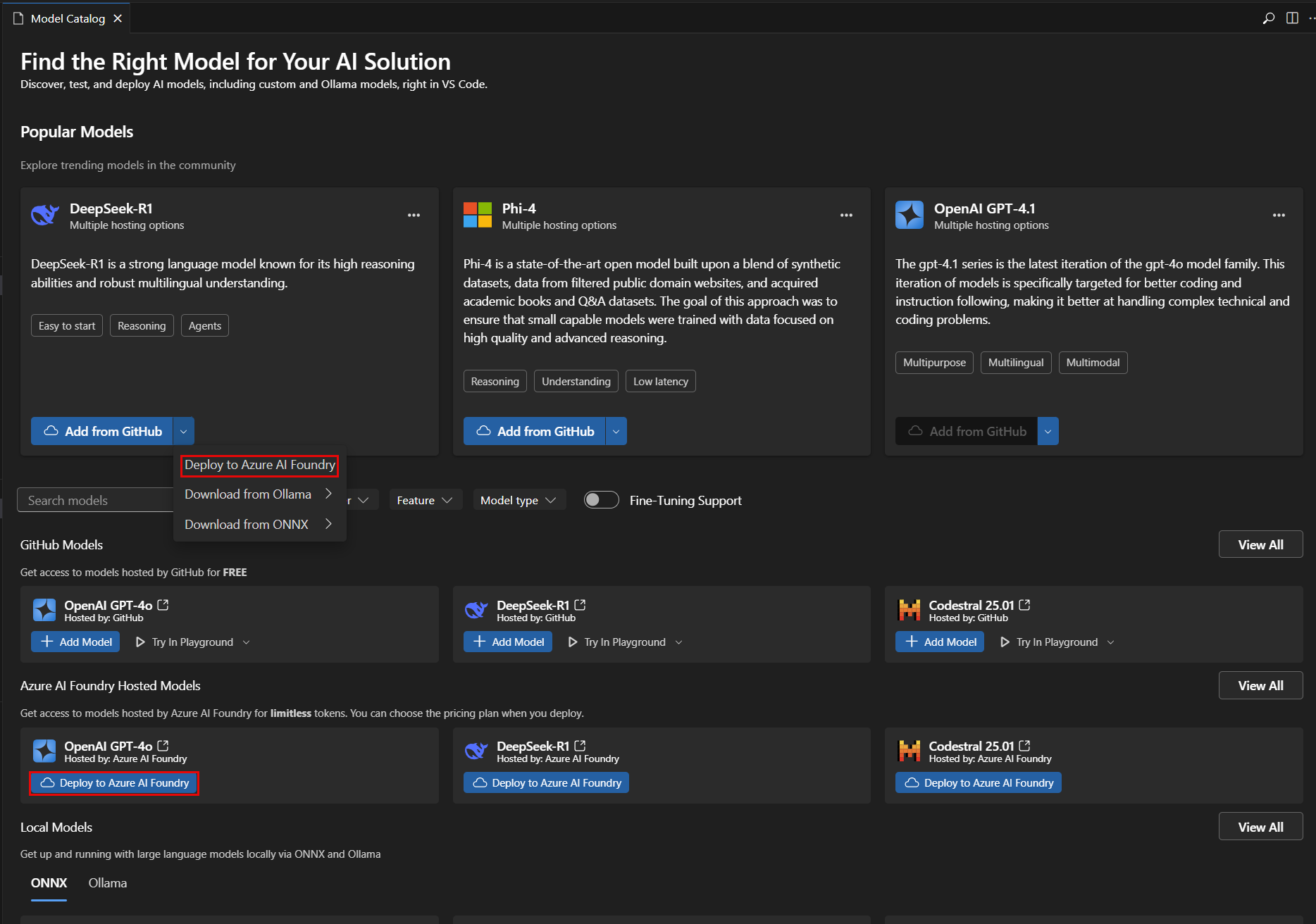

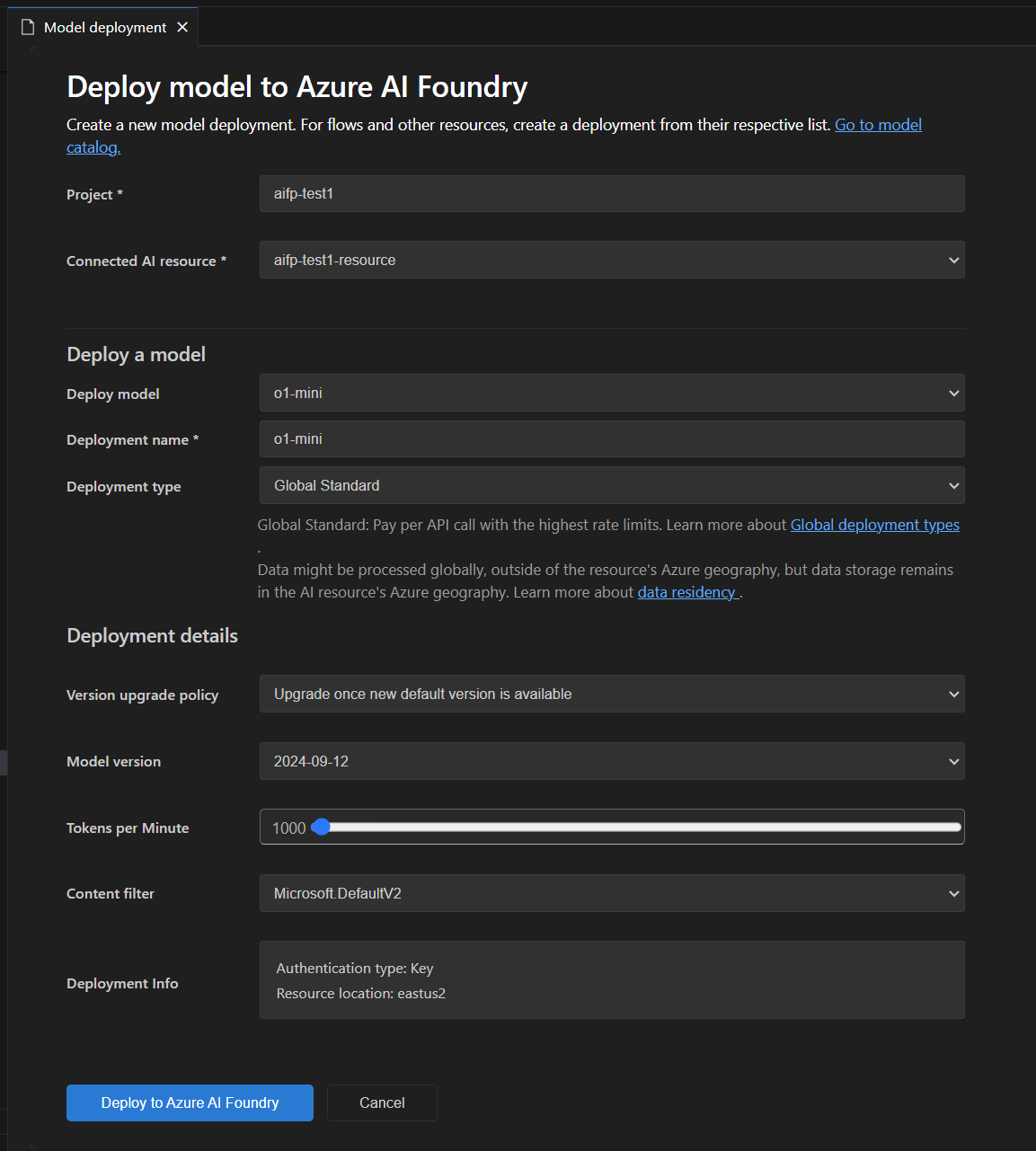

将模型部署到微软Foundry

您可以直接从AI Toolkit将模型部署到Microsoft Foundry。这使您能够在云端运行模型,并通过端点访问它。

-

从模型目录中选择您想要部署的模型。

-

选择部署到微软铸造厂,可以从下拉菜单或直接从部署到微软铸造厂按钮,如下图所示:

-

在模型部署标签页中,输入所需信息,例如模型名称、描述和任何附加设置,如下截图所示:

-

选择部署到微软铸造厂以开始部署过程。

-

将出现一个对话框以确认部署。查看详细信息并选择部署以继续。

-

部署完成后,模型将出现在我的模型部分的AI工具包中,您可以在游乐场或代理构建器中使用它。

选择一个模型进行测试

您可以在聊天完成的游乐场中测试模型。

使用模型目录中模型卡片上的操作:

- 在游乐场尝试:在游乐场中加载所选模型进行测试。

- 在Agent Builder中尝试:在Agent Builder中加载所选模型以构建AI代理。

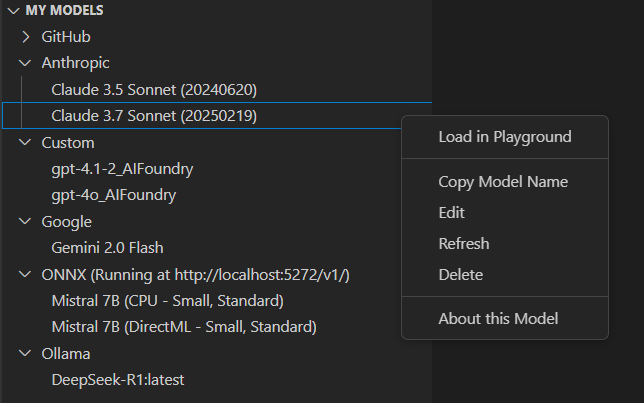

管理模型

您可以在AI工具包视图的我的模型部分管理您的模型。在这里您可以:

-

查看您已添加到AI Toolkit的模型列表。

-

右键单击模型以访问选项,例如:

- 在游乐场加载:在游乐场中加载模型以进行测试。

- 复制模型名称:将模型名称复制到剪贴板,以便在其他上下文中使用,例如您的代码集成。

- 刷新:刷新模型配置以确保您拥有最新的设置。

- 编辑:修改模型设置,例如 API 密钥或端点。

- 删除:从AI工具包中移除模型。

- 关于此模型:查看有关该模型的详细信息,包括其发布者、来源和支持的功能。

-

右键单击

ONNX部分标题以访问选项,例如:- 启动服务器:启动 ONNX 服务器以在本地运行 ONNX 模型。

- 停止服务器:如果 ONNX 服务器正在运行,请停止它。

- 复制端点:将 ONNX 服务器端点复制到剪贴板,以便在其他上下文中使用,例如您的代码集成。

许可证和登录

某些模型需要一个发布者或托管服务许可证和账户来登录。在这种情况下,在您能够在 模型游乐场 中运行模型之前,系统会提示您提供此信息。

你所学到的

在本文中,您将学习如何:

- 在AI Toolkit中探索和管理生成式AI模型。

- 从各种来源找到模型,包括 GitHub、ONNX、OpenAI、Anthropic、Google、Ollama 和自定义端点。

- 将模型添加到您的工具包中,并将其部署到Microsoft Foundry。

- 添加自定义模型,包括与Ollama和OpenAI兼容的模型,并在游乐场或智能体构建器中测试它们。

- 使用模型目录查看可用模型,并选择最适合您AI应用需求的模型。

- 使用筛选器和搜索快速找到模型。

- 按类别浏览模型,例如 Popular、GitHub、ONNX 和 Ollama。

- 使用模型转换工具转换并添加自定义 ONNX 模型。

- 管理我的模型中的模型,包括编辑、删除、刷新和查看详情。

- 启动和停止ONNX服务器,并复制本地模型的端点。

- 在测试某些型号之前,请处理许可证和登录要求。