通过自定义密钥在 VS Code 中扩展模型选择

2025年10月22日 由 奥利维亚·古萨尔多·麦克维克,皮尔斯·博甘

我们知道模型选择对您很重要。我们的团队一直在努力工作,使最新的模型如Claude Haiku 4.5和GPT 5在发布当天就能提供给您。但我们也收到了您的反馈,希望在VS Code中获得更多的模型支持,无论是本地还是云端。

三月份,我们发布了自定义密钥(BYOK)功能,让您可以选择来自 OpenRouter、Ollama、Google、OpenAI 等支持提供商的数百种型号来为 VS Code 中的聊天体验提供动力。

现在,我们正在将BYOK提升到一个新的水平。在v1.104版本中,我们引入了语言模型聊天提供者API,使模型提供者能够通过VS Code扩展直接贡献他们的模型。

什么是自备密钥 (BYOK)?

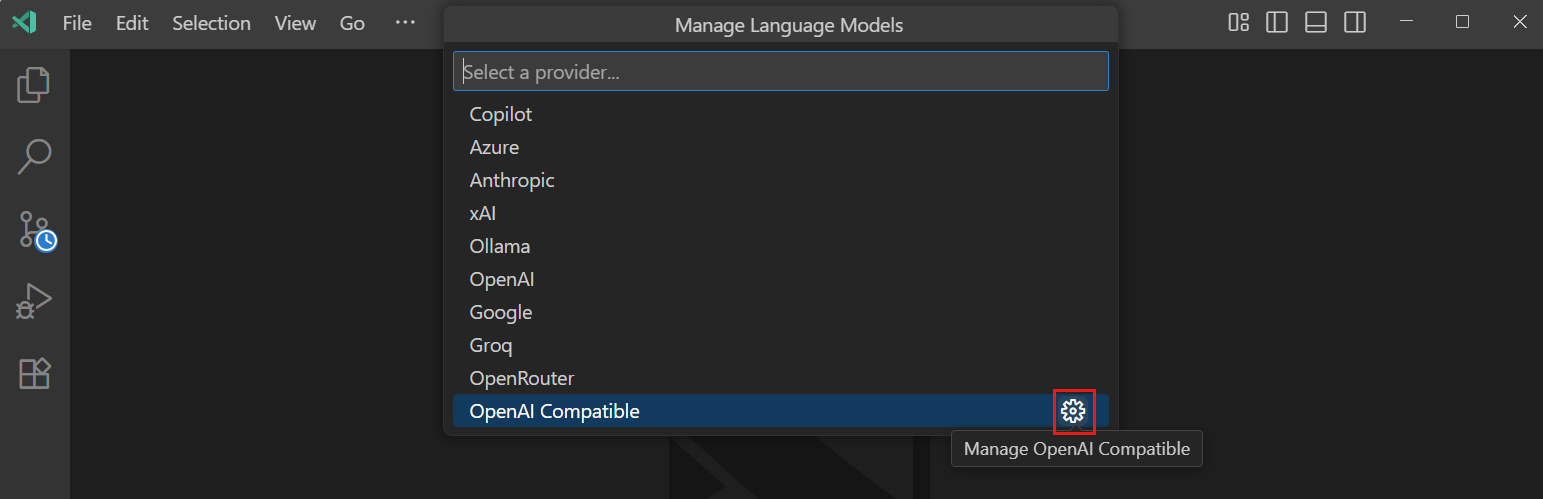

BYOK 让你通过使用支持提供商的 API 密钥来使用任何模型。这意味着你可以访问 VS Code 内置模型之外的庞大模型生态系统。无论你想使用用于代码生成的专用模型、用于一般聊天的其他模型,还是通过像 Ollama 这样的提供商本地模型实验,BYOK 只需使用你的 API 密钥即可实现。你可以通过 Chat: Manage Language Models 命令进行配置。

但是管理不断增加的支持提供商列表对用户和我们的团队都提出了挑战。这就是为什么我们发布了语言模型聊天提供商API,允许模型提供商通过VS Code扩展直接贡献他们的模型。

语言模型聊天提供商API

该语言模型聊天提供商API将BYOK从一个集中式系统转移到一个开放、可扩展的生态系统中,任何提供商都可以通过简单的扩展安装提供他们的模型。我们仍然会支持一部分内置提供商,但这个可扩展的生态系统将使我们能够扩展我们的模型选择以满足开发人员的需求。

通过 Language Model Chat Provider API 提供的模型目前对个人 GitHub Copilot 计划(免费、专业和专业+)的用户可用。

以下是一些我们最喜欢的扩展,您可以立即安装这些扩展以在 VS Code 中访问更多模型:

-

Visual Studio Code 扩展的 AI 工具包 让您可以在 VS Code 中直接访问其提供的模型,无论是您在 Azure AI Foundry 中微调的自定义模型,通过 Foundry Local 的本地模型,还是在 GitHub Models 中的任何模型。

-

Cerebras Inference 为世界顶级编码模型提供动力,使代码生成几乎瞬间完成,非常适合快速迭代。它以每秒2,000个令牌的速度运行Qwen3 Coder和GPT OSS 120B,比大多数推理API快20倍。

-

GitHub Copilot Chat扩展的Hugging Face提供者使您能够在VS Code中直接使用前沿的开放LLM,如Kimi K2、DeepSeek V3.1、GLM 4.5。Hugging Face的推理提供者为开发人员提供了数百个LLM,这些LLM由世界级的推理提供者提供支持,具有高可用性和低延迟。

对于有兴趣贡献自己模型的扩展开发人员,请查看我们的语言模型聊天提供者API文档和示例扩展,以开始今天的构建。

兼容OpenAI的模型

对于使用OpenAI兼容模型的开发人员,您可以使用自定义OpenAI兼容提供程序,用于任何OpenAI兼容的API端点,并配置模型以在聊天中使用。此功能目前仅在VS Code Insiders中可用。

此外,您可以通过以下方式明确配置编辑工具列表github.copilot.chat.customOAIModels设置,使您能够对自定义模型可用的功能进行细粒度控制。

接下来是什么?

语言模型聊天提供商 API 只是为你们带来更多模型选择的开始。随着这个生态系统的成长,我们期待看到:

- 模型管理界面,允许您了解模型功能并管理模型

- 更流畅的流程以安装贡献语言模型的扩展

- 改进内置语言模型提供者,使用最新的提供者API,并根据模型的不同使用专门的提示。

我们正在不断投资于BYOK体验。最近的改进包括改进的编辑工具,以更好地与VS Code的内置工具集成,但我们知道还有工作要做,以使体验感觉更像VS Code的原生体验——例如,BYOK目前不支持完成功能。我们非常希望听到您对我们的GitHub仓库的反馈!

编码愉快!