开源AI编辑器:第二阶段里程碑

2025年11月6日 由VS Code团队

在五月,我们宣布了使 VS Code 成为开源 AI 编辑器的初步计划,而在六月,我们达成了第一个里程碑,开源了 GitHub Copilot Chat 扩展。

虽然聊天是一个重要的进步,但我们的人工智能功能的重要部分仍然存在:即你在输入时出现的即时建议。今天,我们在旅程中达到了下一个里程碑:即时建议现在是开源的。

一个扩展,相同的用户体验

在过去的几年里,GitHub Copilot在VS Code中被分为两个扩展:GitHub Copilot扩展(用于自动完成功能)和GitHub Copilot Chat扩展(用于聊天和下一步编辑建议)。我们正在努力将所有Copilot功能整合到一个VS Code扩展中:Copilot Chat。

为了实现这一点,我们目前正在测试禁用 Copilot 扩展,并从 Copilot Chat 提供所有内联建议。我们已经将大多数功能移植到聊天扩展中,因此单个扩展体验的渐进式发布对每个人来说都应该感觉一致和透明。

您的体验不应有任何变化。 您将继续在输入时获得相同的智能代码建议,并且还可以使用您已经使用的所有聊天和代理模式功能。如果您遇到任何问题,请报告问题或查看如何使用之前的体验(如果需要)。

作为此次重构的一部分,GitHub Copilot 扩展将在 2026 年年初被弃用,这意味着它将从 VS Code 市场上删除。

我们还简化了我们的术语:我们现在使用内联建议来指代所有在您输入时出现的AI生成代码建议(包括幽灵文本和下一个编辑建议)。我们继续努力统一实际的产品体验,包括各种建议的用户体验和时间。

探索和贡献

在vscode-copilot-chat 仓库中提供内联建议,您可以探索和贡献他们如何工作:

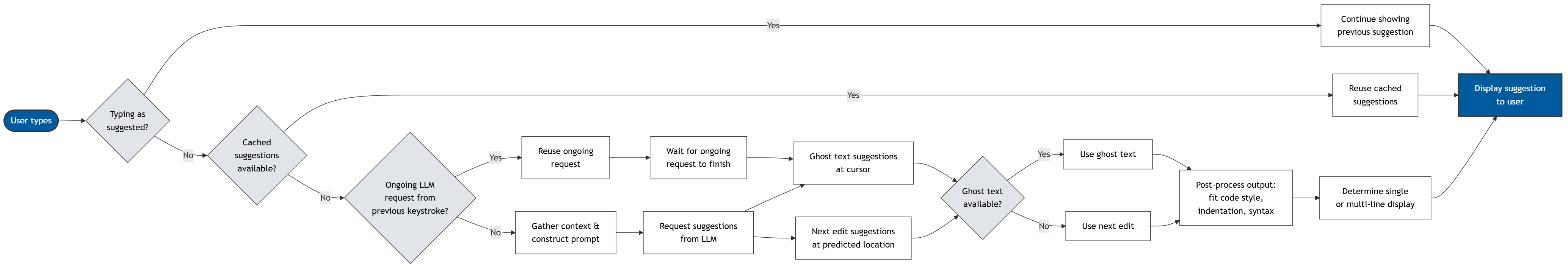

- “建议中的输入”检测 - 在你输入时,该扩展首先检查你是否在遵循之前的建议,并且可以在不发出新请求的情况下继续显示该建议

- 缓存 - 如果不按建议输入,扩展会检查缓存的建议是否可以重复使用以提高性能

- 重用正在进行的请求 - 如果没有缓存的建议,扩展会检查是否有上一次按键的正在进行的LLM请求尚未完成流式传输。由于这个正在进行的请求可能与当前请求相似,扩展会重用它,而不是发送一个新的请求并取消正在进行的请求,这显著提高了性能

- 提示构建 - 如果没有可以复用的正在进行的请求,扩展程序将从当前文件、打开的文件和工作区中收集相关的上下文,然后将其格式化为提示发送到LLM

- 模型推理 - 扩展请求来自多个提供者的内联建议:在光标处的幽灵文本建议,以及下一个编辑建议,这些建议预测您可能会在哪里进行下一个编辑。当可用时,优先考虑光标处的幽灵文本建议;否则,使用下一个编辑建议

- 后处理 - 对原始模型输出进行优化,以确保它们符合您的代码风格、缩进和语法

- 多行智能 - 扩展根据置信度和上下文决定显示单行还是多行

性能改进

除了合并为一个扩展之外,这次重构还带来了内联建议的技术改进:

- 降低延迟 - 我们修复了网络问题,以优化建议的传递方式,使聊天扩展能够更快地提供幽灵文本

- 质量验证 - 我们进行了广泛的实验,以确保延迟和建议质量没有退化

故障排除

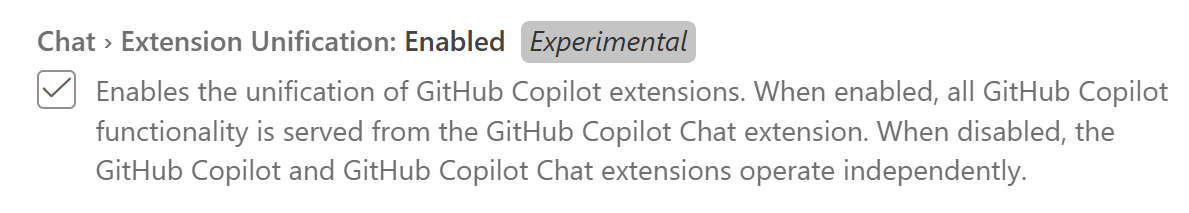

如同所有更改一样,尽管我们尽了最大努力,但有可能会有所遗漏!如果在统一扩展体验中遇到任何问题,您可以暂时通过取消勾选统一设置来恢复以前的两个扩展行为:

接下来是什么?

我们开源软件(OSS)的下一阶段是将 Copilot Chat 扩展中的某些 AI 功能和组件重构到 VS Code 核心中。我们很高兴与社区继续这段旅程,将 VS Code 打造成一个开源的 AI 编辑器,共同塑造开发的未来。

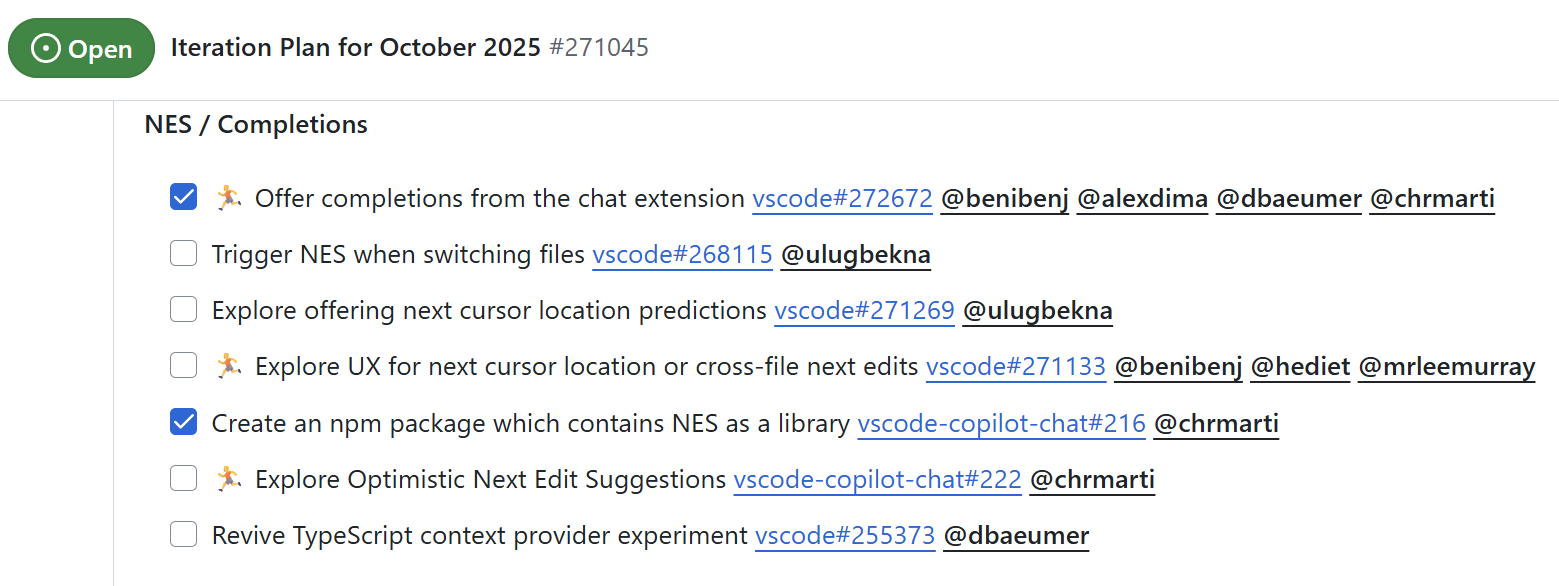

我们将继续积极改进我们的内联建议体验 - 和往常一样,您可以关注我们的迭代计划以获取最新信息:

祝你编码愉快!💙

VS Code 团队